En ren kontrollfråga

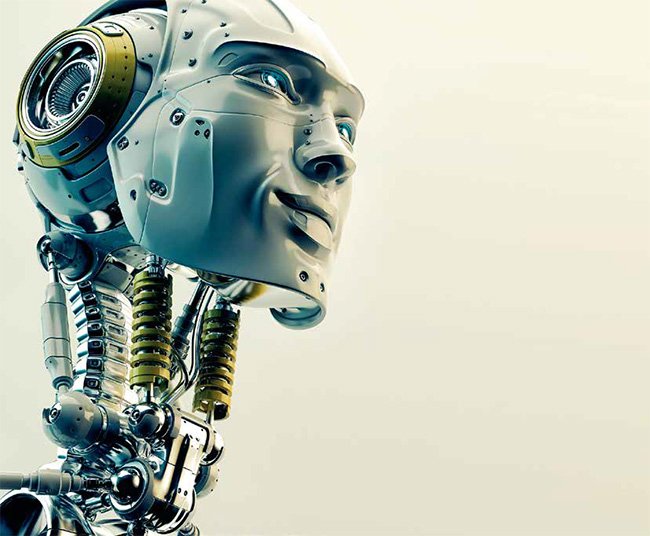

Vi har ständigt funnit nya uppgifter för den mänskliga arbetskraften i ungefär samma takt som de gamla försvunnit (om än med vissa konjunkturvariationer). Idag går dock utvecklingen snabbare än någonsin, och man kan undra vad som väntar då nya framsteg inom artificiell intelligens (AI) gör att inte bara manuellt arbete utan även allt fler och allt mer avancerade intellektuella sysslor automatiseras. Det ligger något i grunden gott i att vi befrias från arbetets vedermödor för att istället fullt ut kunna ägna oss åt konst, kultur, idrott, kärlek eller vad vi nu vill göra, men är det verkligen möjligt att få till stånd en övergång till en sådan utopi utan att vi på vägen drabbas av social utslagning av monstruösa proportioner? Detta är några av de frågor som de åtta skrib...